مُحوِّل الذكاء الاصطناعي للشخصيات

حوّل النصوص المولدة بالذكاء الاصطناعي إلى كتابة شبيهة بالكتابة البشرية. يقلل المحتوى المحسن من إمكانية اكتشافه مع الحفاظ على وضوحه.

🎉 احصل على 7 أشهر مجانًا على أي خطة سنوية - بدون مخاطر، يمكنك الإلغاء في أي وقت

6

HR

0

MIN

0

SEC

اللغات المعتمدة:

Arabic

English

French

Spanish

All others

1 تكلفة الائتمان

وضع الكشف

أساسي

يتقدم

الإضافات الاختيارية

تحليل الجملة

الكشف التفصيلي عن مستوى الجملة

المدقق الانتحال

مسح النص المنسوخ عبر الإنترنت

كاشف الصور بالذكاء الاصطناعي

Check if an image is AI-generated

يكتشف AI Detector المحتوى المكتوب بالذكاء الاصطناعي من خلال الكشف على مستوى الفقرة، والكشف على مستوى الجملة، والتحليل على مستوى الكلمة. يقوم بتقييم مفردات الذكاء الاصطناعي، وكلمات الذكاء الاصطناعي شائعة الاستخدام، والكلمات المفرطة الاستخدام.

يطبق كاشف الذكاء الاصطناعي الكشف على مستوى المستند لمسح المستندات المختلطة ضوئيًا، سواء تلك التي أنشأها الذكاء الاصطناعي أو التي أنشأها الإنسان. CudekAI يتحقق AI Checker من الأنماط التي تم إنشاؤها بواسطة الذكاء الاصطناعي بنتائج دقيقة.

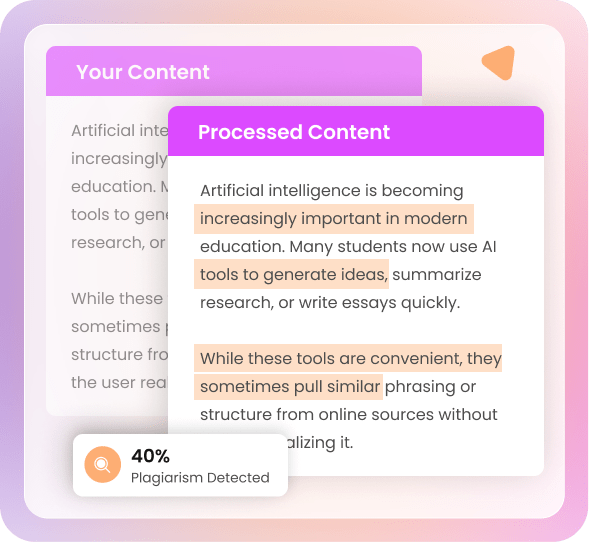

يكتشف AI Checker المحتوى المنسوخ، والانتحال غير المقصود، والمحتوى المكرر. يقوم CudekAI كاشف الانتحال بفحص المقالات والمقالات والأوراق البحثية ومحتوى الويب للتحقق من أصالة المحتوى.

يجمع CudekAI بين اكتشاف الذكاء الاصطناعي ومسح الانتحال لإجراء تحليل كامل للأصالة.

مدقق الذكاء الاصطناعي للكشف عن الانتحالCudekAI يقوم كاشف الصور بمسح العناصر المرئية التي تم إنشاؤها بواسطة الذكاء الاصطناعي. إنه يتحقق من صحة صورة AI عبر تنسيقات متعددة مدعومة. يقوم مدقق الصور بالذكاء الاصطناعي بمراجعة المحتوى المرئي لتسجيل احتمالية الذكاء الاصطناعي.

يقوم كاشف الصور بتصنيف النتائج باستخدام معدل الذكاء الاصطناعي ودرجة الذكاء الاصطناعي المرئي للإشارة إلى إمكانيات الذكاء الاصطناعي المنخفضة أو المتوسطة أو العالية مع تحليل واضح ومنظم للصور للتحقق الدقيق.

كاشف الصور بالذكاء الاصطناعي

detector.py

يقوم برنامج CudekAI Code Detector بتحليل شفرة المصدر لتحديد الأنماط التي يولدها الذكاء الاصطناعي في لغات البرمجة Python وJavaScript وTypeScript وJava وC++ وGo وغيرها. كما يفحص البرنامج اصطلاحات التسمية وأسلوب التعليقات والإشارات الهيكلية للتحقق من هوية كاتب الشفرة.

يقدم مدقق التعليمات البرمجية المدعوم بالذكاء الاصطناعي درجة احتمالية الذكاء الاصطناعي مقابل الإنسان مع تمييز على مستوى السطر وحكم واضح لدعم مراجعات التعليمات البرمجية وتقييمات التوظيف وفحوصات النزاهة الأكاديمية.

استخدم كاشف الرموز المدعوم بالذكاء الاصطناعيحوّل النصوص المولدة بالذكاء الاصطناعي إلى كتابة شبيهة بالكتابة البشرية. يقلل المحتوى المحسن من إمكانية اكتشافه مع الحفاظ على وضوحه.

يكشف عن المحتوى المنسوخ ويحدد حالات الانتحال غير المقصود من خلال خوارزميات الكشف المتقدمة.

حدد الأخطاء النحوية وعلامات الترقيم وبنية الجمل وقم بتصحيحها. حسّن سهولة القراءة بنقرة واحدة.

راجع أسلوب الكتابة، وبنيتها، ودرجة سهولة قراءتها لاكتشاف الأخطاء التي تم التغاضي عنها قبل الإرسال.

اكتشف الكتابة بالذكاء الاصطناعي في اللغات الإنجليزية والإسبانية والفرنسية والألمانية واليابانية والمجرية وغيرها.

ترجمة المحتوى عبر 104 لغات مع الحفاظ على النية الأصلية والسياق.

فحص المقالات بحثًا عن أنماط الذكاء الاصطناعي، والانتحال، والبنية. يساعد ذلك في التقييم العادل.

حوّل المستندات الطويلة إلى ملخصات موجزة. فالتلخيص المركز يحافظ على المعلومات مباشرة.

أعد صياغة الجمل لتحسين الوضوح وتجنب التكرار دون فقدان المعنى الرئيسي.

أعد صياغة الجمل والفقرات باستخدام المرادفات لتحسين سهولة القراءة وسلاسة النص.

ألصق النص مباشرةً لبدء عملية الفحص. أدخل عنوان URL أو حمّل ملفات DOCX أو PDF أو TXT أو RTF. يقوم كاشف الذكاء الاصطناعي CudekAI بفحص ما يصل إلى 15000 حرف.

قم بتشغيل مدقق الذكاء الاصطناعي لإجراء تحليل على مستوى الكلمة، ومستوى الجملة، ومستوى الفقرة، وعلى مستوى المستند. يقوم كاشف الذكاء الاصطناعي تلقائيًا بالبحث عن المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي والمسروق.

سيقوم كاشف CudekAI بمسح النص في ثوانٍ. قم بتنزيل التقرير التفصيلي بتنسيق PDF وDOCX أو قم بإنشاء رابط قابل للمشاركة.

اكتشف محتوى الذكاء الاصطناعي الناتج عن أفضل نماذج الذكاء الاصطناعي

يكتشف المحتوى الذي تم إنشاؤه بواسطة GPT-5، وGPT-4، وGPT-3، وGPT-4.1، وGPT-4.1-Mini. يضمن تسجيل احتمالات الذكاء الاصطناعي الدقيق إجراء تحليل موثوق.

CudeKAI يكتشف مدقق الذكاء الاصطناعي النص بواسطة Gemini 3، وGemini 2.5 Pro، وGemini 2.5 Flash، وGemini 2.5 Flash-Lite مع التحليل المنظم.

تحديد النص الآلي من كلود السوناتة 4 باستخدام تحليل مستوى الجملة والوثيقة.

يحدد كاشف الذكاء الاصطناعي الأنماط اللغوية التي تنتجها اللاما.

يكتشف النص الذي تم إنشاؤه بواسطة نماذج DeepSeek باستخدام تحليل بصمة الذكاء الاصطناعي التكيفي

تحليل المحتوى المكتوب بالذكاء الاصطناعي الذي أنشأته Grok باستخدام منطق المقارنة بين النماذج.

الدقة والتحليل التفصيلي والنتائج الفورية

يستخدم CudekAI نموذجًا عالي الدقة لاكتشاف موثوق به بواسطة الذكاء الاصطناعي. تتحقق المعايير المستقلة والاختبارات واسعة النطاق من دقة الكشف. يقلل نموذج كاشف الذكاء الاصطناعي من الإيجابيات الخاطئة والتصنيفات الخاطئة، بينما تؤكد المعايير الأداء المتسق عبر نماذج الذكاء الاصطناعي المتعددة.

يحظى CudekAI بثقة المعلمين والطلاب والباحثين عبر المؤسسات الأكاديمية والكليات والجامعات. يستخدم النظام المدرسي كاشف الذكاء الاصطناعي للتحقق من الذكاء الاصطناعي في المقالات والأوراق البحثية ومحتوى المدونات للتحقق الدقيق.

يعتمد مؤلفو النصوص والمسوقون والقائمون بالتوظيف والناشرون والمؤلفون على درجة اكتشاف الذكاء الاصطناعي الدقيقة. يتم تحليل كل إرسال للتأكد من أن المحتوى عالي المخاطر يلبي معايير الأصالة.

الأفضل للوكالات

التسعير المخصص

Credits: Tailored for You

كاشف الذكاء الاصطناعي

إنساني

مدقق الانتحال

كاشف الصور بالذكاء الاصطناعي

جميع التطبيقات متضمنة

مترجم

ينفذ اكتشافًا جماعيًا للذكاء الاصطناعي من خلال تكامل واجهة برمجة التطبيقات (API) عن طريق إدخال المحتوى والحصول على وصول واجهة برمجة التطبيقات (API) إلى كاشف الذكاء الاصطناعي لإجراء عمليات فحص تلقائية. تدعم واجهة برمجة التطبيقات اكتشاف الذكاء الاصطناعي وفحص الانتحال وإعادة الصياغة والترجمة.

فوري

تحليل شامل

هل أنت مستعد للأتمتة؟

احصل على إمكانية الوصول إلى واجهة برمجة التطبيقات (API) اليوم.

أداة كشف محتوى Ai المجانية متاحة بلغة 103

English

Afrikaans

Albanian

Amharic

Arabic

Armenian

Azerbaijani

Basque

Belarusian

Bengali

Bosnian

Bulgarian

Catalan

Cebuano

Chichewa

Chinese Simplified

Chinese Traditional

Corsican

Croatian

Czech

Danish

Dutch

Esperanto

Estonian

Filipino

Finnish

French

Frisian

Galician

Georgian

German

Greek

Gujarati

Haitian Creole

Hausa

Hawaiian

Hebrew

Hindi

Hmong

Hungarian

Icelandic

Igbo

Indonesian

Irish

Italian

Japanese

Javanese

Kannada

Kazakh

Khmer

Korean

Kurdish

Kyrgyz

Lao

Latin

Latvian

Lithuanian

Luxembourgish

Macedonian

Malagasy

Malay

Malayalam

Maltese

Maori

Marathi

Mongolian

Myanmar

Nepali

Norwegian

Pashto

Persian

Polish

Portuguese

Romanian

Russian

Samoan

Scots Gaelic

Serbian

Sesotho

Shona

Sindhi

Sinhala

Slovak

Slovenian

Somali

Spanish

Sundanese

Swahili

Swedish

Tajik

Tamil

Telugu

Thai

Turkish

Ukrainian

Urdu

Uzbek

Vietnamese

Welsh

Xhosa

Yiddish

Yoruba

Zulu

لقد كان كاشف الذكاء الاصطناعي الخاص بـ Cudekai بمثابة متنفس حقيقي من التوتر. بعض أساتذتي متشددون بشأن الأعمال المكتوبة بواسطة الذكاء الاصطناعي، وهذه الأداة تمنحني الثقة بأن أوراقي تبدو أصلية قبل تسليمها.

Daniel

أستخدم أداة تحسين الصوت البشري من Cudekai بعد الانتهاء من كتابة أوراقي للتأكد من أنها تبدو فعلاً كصوتي. فهي تُحسّن الكتابة وتجعلها سلسة وطبيعية، تماماً كصوتي، ولكن بأسلوب أكثر صقلاً.

Chelsea

عندما أواجه صعوبة في إعادة صياغة شيء ما، أقوم ببساطة بإضافته إلى أداة إعادة الصياغة الخاصة بـ Cudekai، مما يمنحني نسخًا أنظف وأوضح في ثوانٍ ويوفر لي الكثير من الوقت لأعمال أخرى.

Ricardo

أداة كشف الانتحال من Cudekai ممتازة حقًا. التقارير مفصلة وسهلة الفهم، مما يُسهّل حل المشكلات بسرعة كبيرة. إنها أداة لا غنى عنها في مشاريعي.

Michael